Ваш кабинет врача-ИИ расширяется. 7 января компания OpenAI объявила о запуске в ближайшие недели ChatGPT Health — специальной вкладки для здоровья, которая позволит пользователям загружать свои медицинские записи и подключать такие приложения, как Apple Health, платформа персонализированного тестирования здоровья Function и MyFitnessPal.

По данным компании, более 40 миллионов человек ежедневно задают ChatGPT вопросы, связанные со здоровьем, что составляет более 5% всех сообщений на платформе по всему миру — поэтому с точки зрения бизнеса развитие направления «Здоровье» имеет смысл. Но как насчет точки зрения пациента?

«Я не была шокирована этой новостью», — говорит доктор Даниэль Биттерман, врач-радиолог и руководитель клинического направления по анализу данных и ИИ в Mass General Brigham Digital. «Я думаю, что это говорит о неудовлетворенной потребности людей в отношении своего здоровья. Трудно попасть на прием к врачу, сегодня сложно найти медицинскую информацию, и, к сожалению, существует некоторое недоверие к медицинской системе».

Мы спросили экспертов, стоит ли передавать свои медицинские данные инструменту на основе искусственного интеллекта.

Что такое ChatGPT Health?

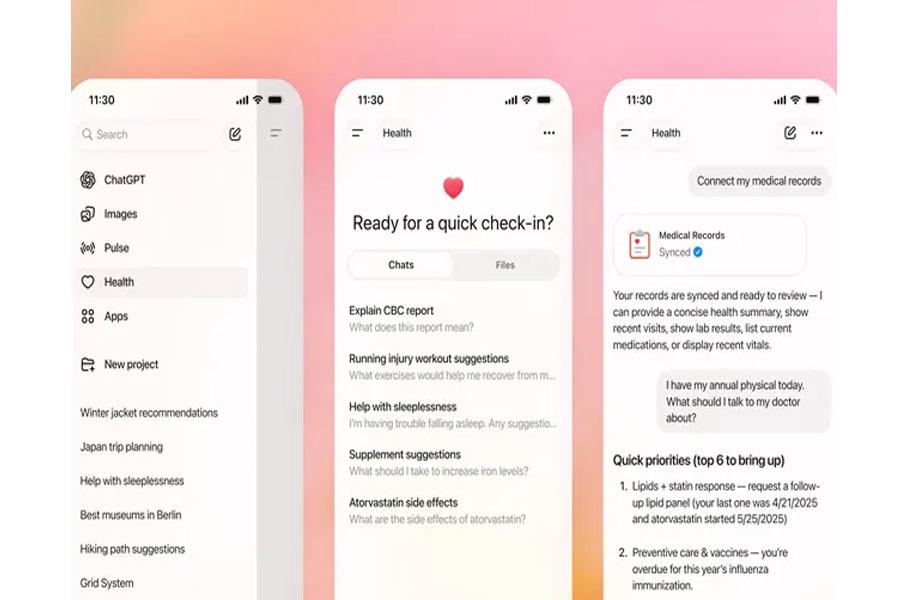

Новая функция станет центром, куда люди смогут загружать свои медицинские записи, включая результаты анализов, сводки посещений и историю болезни. Таким образом, когда вы задаете боту вопросы, они будут «основаны на предоставленной вами информации», — говорится в заявлении компании. OpenAI предлагает задавать такие вопросы, как: «Как меняется мой уровень холестерина?», «Можете ли вы кратко изложить результаты моих последних анализов крови перед приемом?», «Дайте мне краткий обзор моего общего состояния здоровья». Или: «У меня завтра ежегодный медицинский осмотр. О чем мне следует поговорить с врачом?»

Пользователи также могут подключить ChatGPT к Apple Health, чтобы инструмент искусственного интеллекта имел доступ к таким данным, как количество шагов в день, продолжительность сна и количество сожженных калорий во время тренировки. Еще одно нововведение — возможность синхронизации с данными от Function, компании, которая проводит анализы более чем 160 маркеров в крови, так что ChatGPT имеет доступ к результатам лабораторных исследований, а также к рекомендациям врачей по здоровью. Пользователи также могут подключить MyFitnessPal для получения советов по питанию и рецептов, а также Weight Watchers для идей блюд и рецептов, ориентированных на тех, кто принимает препараты GLP-1.

Компания OpenAI, имеющая лицензионное и технологическое соглашение, позволяющее ей получать доступ к архивам TIME, отмечает, что Health разработан для поддержки здравоохранения, а не для его замены, и не предназначен для использования в целях диагностики или лечения. Компания заявляет, что потратила два года на работу с более чем 260 врачами из десятков специальностей, чтобы сформировать возможности инструмента, а также то, как он реагирует на пользователей. Это включает в себя то, насколько срочно система побуждает людей обращаться к своему врачу, способность четко излагать информацию без чрезмерного упрощения, а также приоритет безопасности в случаях, когда люди находятся в состоянии психического расстройства.

Безопасно ли загружать свои медицинские данные?

Компания OpenAI заключила партнерское соглашение с b.well, компанией, занимающейся инфраструктурой подключения данных, чтобы позволить пользователям безопасно подключать свои медицинские записи к инструменту. Согласно объявлению, вкладка «Здоровье» будет иметь «повышенную конфиденциальность», включая отдельную историю чатов и функцию памяти, отличающуюся от других вкладок. OpenAI также заявила, что «разговоры в разделе «Здоровье» не используются для обучения наших базовых моделей», и информация из раздела «Здоровье» не будет передаваться в чаты вне раздела «Здоровье». Кроме того, пользователи могут «просматривать или удалять воспоминания из раздела «Здоровье» в любое время».

Тем не менее, некоторые эксперты призывают к осторожности. «Наиболее консервативный подход заключается в том, чтобы исходить из того, что любая информация, которую вы загружаете в эти инструменты, или любая информация, которая может находиться в приложениях, которые вы иным образом связываете с этими инструментами, больше не будет конфиденциальной», — говорит Биттерман.

Никакой федеральный регулирующий орган не контролирует информацию о здоровье, предоставляемую чат-ботам с искусственным интеллектом, а ChatGPT предоставляет технологические услуги, которые не подпадают под действие HIPAA. «В этот момент это уже договорное соглашение между физическим лицом и OpenAI», — говорит Брэдли Малин, профессор биомедицинской информатики в Медицинском центре Университета Вандербильта. «Если вы предоставляете данные напрямую технологической компании, которая не предоставляет никаких медицинских услуг, то будьте осторожны». В случае утечки данных у пользователей ChatGPT не будет никаких особых прав в соответствии с HIPAA, добавляет он, хотя возможно, что Федеральная торговая комиссия может вмешаться от вашего имени, или вы можете подать в суд на компанию напрямую. Поскольку медицинская информация и ИИ начинают пересекаться, последствия пока остаются неясными.

«Когда вы обращаетесь к своему врачу и взаимодействуете с ним, существует профессиональное соглашение о том, что он будет хранить эту информацию в конфиденциальности, но в данном случае это не так», — говорит Малин. «Вы точно не знаете, что они будут делать с вашими данными. Они говорят, что будут их защищать, но что именно это означает?»

Когда 8 января у OpenAI запросили комментарий, издание TIME сослалось на сообщение на X от директора по информационной безопасности Дейна Стакки. «Разговоры и файлы в ChatGPT по умолчанию шифруются как в состоянии покоя, так и при передаче в рамках нашей основной архитектуры безопасности», — написал он. «Для Health мы развили эту основу, добавив дополнительные многоуровневые меры защиты. Это включает в себя еще один уровень шифрования… усиленную изоляцию и сегментацию данных». Он добавил, что внесенные компанией изменения «дают вам максимальный контроль над тем, как используются ваши данные и как к ним осуществляется доступ».

Доверяет ли он им? «В какой-то степени доверяю, отчасти потому, что у них есть очень сильный корпоративный интерес в том, чтобы не испортить всё», — говорит он. «Если они хотят затрагивать такие деликатные темы, как здоровье, их репутация будет зависеть от того, насколько комфортно вам будет это делать, и при первой же утечке данных они скажут: «Уберите мои данные оттуда — я больше не буду ими делиться».

Вахтер говорит, что если бы в его записях содержалась информация, которая могла бы нанести ущерб в случае утечки — например, история употребления наркотиков в прошлом, — он бы не стал загружать её в ChatGPT. «Я бы был немного осторожен», — говорит он. «У всех будет своё мнение на этот счёт, и со временем, по мере того как люди будут чувствовать себя более комфортно, если вы считаете, что получаете от этого пользу, я думаю, люди будут вполне охотно делиться информацией».

Риск предоставления неверной информации

Помимо проблем с конфиденциальностью, существуют известные риски использования чат-ботов на основе больших языковых моделей для предоставления информации о здоровье. Биттерман недавно стал соавтором исследования, в котором было установлено, что модели разрабатываются таким образом, чтобы отдавать приоритет полезности, а не медицинской точности, и всегда предоставлять ответ, особенно тот, на который пользователь, скорее всего, отреагирует. Например, в одном эксперименте модели, обученные распознавать, что ацетаминофен и тайленол — это одно и то же лекарство, все равно предоставляли неточную информацию, когда их спрашивали, почему один препарат безопаснее другого.

«Порог баланса между полезностью и точностью находится скорее на стороне полезности», — говорит Биттерман. «Но в медицине нам нужно больше ориентироваться на точность, даже если это происходит в ущерб полезности».

Кроме того, многочисленные исследования показывают, что если в ваших медицинских записях отсутствует информация, модели с большей вероятностью будут выдавать ложные или неверные результаты. Согласно отчету Национального института стандартов и технологий о поддержке ИИ в здравоохранении, качество и полнота медицинских данных, которые пользователь предоставляет чат-боту, напрямую определяют качество результатов, которые генерирует чат-бот; некачественные или неполные данные приводят к неточным и ненадежным результатам. В отчете отмечается, что несколько общих характеристик помогают повысить качество данных: правильная, фактическая информация, которая является исчерпывающей, полной и последовательной, без каких-либо устаревших или вводящих в заблуждение сведений.

В США, по словам Биттерман, «мы получаем медицинскую помощь из разных источников, и она фрагментирована во времени, поэтому большая часть наших медицинских записей неполна». Это увеличивает вероятность ошибок, когда система пытается угадать, что произошло в областях, где есть пробелы, говорит она.

Лучший способ использования ChatGPT Health

В целом, Вахтер считает ChatGPT Health шагом вперед по сравнению с текущей версией. Люди уже использовали бота для медицинских запросов, и, предоставляя ему больше контекста через свои медицинские записи — например, историю диабета или тромбозов — он считает, что они получат более полезные ответы.

«Я думаю, что сегодня вы получите более качественный результат, чем раньше, если вся необходимая информация будет предоставлена», — говорит он. «Знание этого контекста было бы полезно. Но я думаю, что сами инструменты со временем должны улучшиться и стать немного более интерактивными, чем сейчас».

Когда доктор Адам Родман посмотрел вводный видеоролик ChatGPT Health, он остался доволен увиденным. «Мне показалось, что это довольно хорошо», — говорит Родман, врач-терапевт в медицинском центре Beth Israel Deaconess, где он возглавляет рабочую группу по интеграции ИИ в учебную программу медицинских вузов, и доцент Гарвардской медицинской школы. «В нем основное внимание уделяется использованию ИИ для лучшего понимания своего здоровья — не в качестве замены, а как способ его улучшения». Поскольку люди уже использовали ChatGPT для таких вещей, как анализ результатов лабораторных анализов, новая функция просто сделает это проще и удобнее, говорит он. «Я думаю, что это больше отражает то, как будет выглядеть здравоохранение в 2026 году, чем какая-либо сверхновая функция», — говорит он. «Это реальность того, как меняется здравоохранение».

Когда Родман консультирует своих пациентов по вопросам оптимального использования инструментов искусственного интеллекта, он советует им избегать вопросов, касающихся управления здоровьем, например, просьб к боту выбрать оптимальную программу лечения. «Не позволяйте ему принимать автономные медицинские решения», — говорит он. Но вполне допустимо спросить, не упускает ли ваш врач чего-то важного, или обсудить «малорисковые» вопросы, такие как диета и планы физических упражнений, или интерпретация данных о сне.

Один из любимых способов использования ChatGPT — это помощь в обдумывании вопросов перед визитом к врачу. По ее словам, такое дополнение к уже оказанной медицинской помощи — хорошая идея, и у нее есть одно очевидное преимущество: «Вам не обязательно загружать свои медицинские записи».