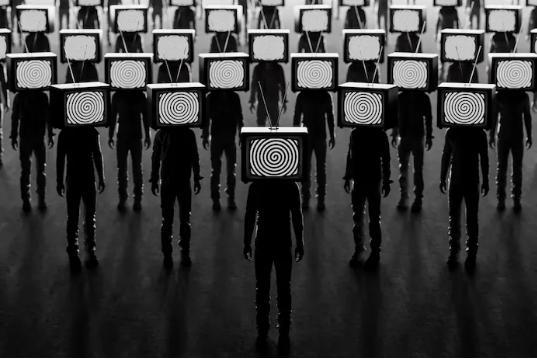

Искусственный интеллект позволяет любому человеку легко создавать пропагандистские СМИ, производя контент, который трудно отличить от реальных новостей

Искусственный интеллект автоматизирует создание фейковых новостей, стимулируя взрывной рост веб-контента, имитирующего фактические статьи, которые вместо этого распространяют ложную информацию о выборах, войнах и стихийных бедствиях.

С мая количество веб-сайтов, на которых размещаются ложные статьи, созданные искусственным интеллектом, увеличилось более чем на 1 000 процентов, увеличившись с 49 до более чем 600, по данным NewsGuard, организации, которая отслеживает дезинформацию.

Исторически сложилось так, что пропагандистские операции опирались на армии низкооплачиваемых работников или хорошо скоординированные разведывательные организации для создания сайтов, которые казались законными. Но искусственный интеллект позволяет практически любому человеку — будь то сотрудник шпионского агентства или просто подросток в подвале — создавать такие СМИ, производя контент, который порой трудно отличить от реальных новостей.

В одной из статей, сгенерированных искусственным интеллектом, рассказывалась выдуманная история о психиатре Биньямина Нетаньяху, как показало расследование NewsGuard, в которой утверждалось, что он умер и оставил записку, предполагающую причастность израильского премьер-министра. Психиатр, по-видимому, был вымышленным, но это утверждение было показано в иранском телешоу, и оно было распространено на сайтах СМИ на арабском, английском и индонезийском языках, а также распространено пользователями в TikTok, Reddit и Instagram.

Как не попасться на удочку дезинформации и изображений ИИ в социальных сетях

Повышенный поток поляризующего и вводящего в заблуждение контента может затруднить понимание того, что является правдой, нанося вред политическим кандидатам, военным лидерам и усилиям по оказанию помощи. Эксперты по дезинформации заявили, что быстрый рост этих сайтов вызывает особое беспокойство в преддверии выборов 2024 года.

«Некоторые из этих сайтов генерируют сотни, если не тысячи статей в день», — сказал Джек Брюстер, исследователь NewsGuard, который проводил расследование. «Вот почему мы называем его следующим великим суперраспространителем дезинформации».

Генеративный искусственный интеллект открыл эру, в которой чат-боты, создатели изображений и клоны голоса могут создавать контент, который кажется созданным человеком.

Хорошо одетые ведущие новостей, сгенерированные искусственным интеллектом, извергают прокитайскую пропаганду, усиленную сетями ботов, симпатизирующими Пекину. В Словакии политики, участвующие в выборах, обнаружили, что их голоса были клонированы, чтобы говорить спорные вещи, которые они никогда не произносили, за несколько дней до того, как избиратели пришли на избирательные участки. Растущее число веб-сайтов с общими названиями, такими как iBusiness Day или Ireland Top News, распространяют фейковые новости, выглядящие подлинными, на десятках языков от арабского до тайского.

Читатели могут быть легко обмануты веб-сайтами.

Издание Global Village Space, опубликовавшее статью о предполагаемом психиатре Нетаньяху, наводнено статьями на самые разные серьезные темы. Там подробно описываются санкции США в отношении российских поставщиков оружия; инвестиции нефтяного гиганта Saudi Aramco в Пакистан; и все более напряженные отношения Соединенных Штатов с Китаем.

Сайт также содержит эссе, написанные экспертом по Ближнему Востоку, юристом, получившим образование в Гарварде, и исполнительным директором сайта Моидом Пирзада, ведущим телевизионных новостей из Пакистана. (Пирзада не ответил на просьбу о комментарии. Два участника подтвердили, что они написали статьи, появившиеся на Global Village Space.)

Но, по словам Брюстера, к этим обычным историям примыкают статьи, сгенерированные искусственным интеллектом, такие как статья о психиатре Нетаньяху, которая была переименована в «сатиру» после того, как NewsGuard связался с организацией во время ее расследования. NewsGuard сообщает, что эта история, по-видимому, была основана на сатирической статье, опубликованной в июне 2010 года, в которой содержались аналогичные утверждения о смерти израильского психиатра.

Тест: Сделал ли это ИИ? Проверьте свои знания.

Наличие реальных новостей и новостей, сгенерированных искусственным интеллектом, делает обманчивые истории более правдоподобными. «Есть люди, которые просто недостаточно грамотны в средствах массовой информации, чтобы знать, что это ложь», — сказал Джеффри Блевинс, эксперт по дезинформации и профессор журналистики в Университете Цинциннати. — Это вводит в заблуждение.

Веб-сайты, подобные Global Village Space, могут распространиться во время выборов 2024 года, став эффективным способом распространения дезинформации, считают эксперты по СМИ и искусственному интеллекту.

По словам Брюстера, сайты работают в двух направлениях. Некоторые истории создаются вручную, когда люди запрашивают у чат-ботов статьи, которые усиливают определенный политический нарратив, и публикуют результат на веб-сайте. Процесс также может быть автоматическим: парсеры ищут статьи, содержащие определенные ключевые слова, и загружают эти истории в большую языковую модель, которая переписывает их, чтобы они звучали уникально и избегали обвинений в плагиате. Результат автоматически публикуется в Интернете.

NewsGuard обнаруживает сайты, созданные искусственным интеллектом, сканируя сообщения об ошибках или другие формулировки, которые «указывают на то, что контент был создан инструментами искусственного интеллекта без адекватного редактирования», — говорится в сообщении организации.

Мотивы для создания этих сайтов различны. Некоторые из них предназначены для того, чтобы повлиять на политические убеждения или посеять хаос. Другие сайты штампуют поляризующий контент, чтобы привлечь клики и получить доход от рекламы, сказал Брюстер. Но возможность наращивать количество поддельного контента является серьезным риском для безопасности, добавил он.

Технологии уже давно подпитывают дезинформацию. В преддверии выборов в США в 2020 году восточноевропейские «фабрики троллей» — профессиональные группы, продвигающие пропаганду, — создали большую аудиторию в Facebook, распространяя провокационный контент на страницах групп чернокожих и христиан, достигнув 140 миллионов пользователей в месяц.

Вы, наверное, распространяете дезинформацию. Вот как это сделать.

По словам Пойнтера, журналистские сайты с розовой слизью, названные в честь мясного субпродукта, часто появляются в небольших городах, где исчезли местные новостные агентства, генерируя статьи, которые приносят пользу финансистам, финансирующим операцию.

Но Блевинс сказал, что эти методы более ресурсоемкие по сравнению с искусственным интеллектом. «Опасность заключается в масштабах и масштабах ИИ… Особенно в паре с более сложными алгоритмами», — сказал он. «Это информационная война такого масштаба, какого мы раньше не видели».

Неясно, используют ли спецслужбы новости, генерируемые искусственным интеллектом, для кампаний иностранного влияния, но это вызывает серьезную озабоченность. «Я бы совсем не был шокирован тем, что это используется — определенно в следующем году с выборами», — сказал Брюстер. «Трудно не видеть, как какой-нибудь политик создает один из этих сайтов, чтобы генерировать нелепый контент о них и дезинформацию о своем оппоненте».

Блевинс сказал, что люди должны следить за подсказками в статьях, «красными флажками», такими как «действительно странная грамматика» или ошибки в построении предложений. Но самым эффективным инструментом является повышение медиаграмотности у среднестатистического читателя.

«Расскажите людям о том, что существуют такие сайты. Это тот вред, который они могут причинить”, – сказал он. «Но также следует признать, что не все источники одинаково заслуживают доверия. То, что что-то претендует на звание новостного сайта, не означает, что у них на самом деле есть журналист… Создание контента».

Регулирование, добавил он, в значительной степени отсутствует. Правительствам может быть трудно пресекать фейковый новостной контент, опасаясь нарушить защиту свободы слова. Это остается на усмотрение социальных сетей, которые до сих пор не проделали хорошую работу.

Быстро разобраться с огромным количеством таких сайтов невозможно. «Это очень похоже на игру в «бей крота», — сказал Блевинс.

«Вы замечаете один [сайт], закрываете его, а другой создается где-то в другом месте», — добавил он. «Ты никогда не сможешь полностью наверстать упущенное».

Праншу Верма (Pranshu Verma) — репортер технологической команды The Washington Post. До прихода в The Post в 2022 году он освещал технологии в Boston Globe. До этого он работал репортером в New York Times и Philadelphia Inquirer.